Europese privacywetgeving, zoals GDPR, zet onze techbedrijven op achterstand in de ontwikkeling van kunstmatige intelligentie, meent Arjan van Hessen.

Wij leven in een wonderlijke tijd. Komend jaar treedt de nieuwe Europese wetgeving voor databescherming, de General Data Protection Regulation (kortweg GDPR) in werking. Hierdoor wordt het voor bedrijven een stuk lastiger om structureel persoonsgebonden data te verzamelen, langdurig te bewaren en met anderen te delen. Een strop om de nek van Europese techbedrijven, die deze data hard nodig hebben in hun strijd naar het nieuwe IT-goud: het talig vermogen.

Arjan van Hessen is onderzoeker taal- en spraaktechnologie aan de

Arjan van Hessen is onderzoeker taal- en spraaktechnologie aan de

Universiteit Twente.

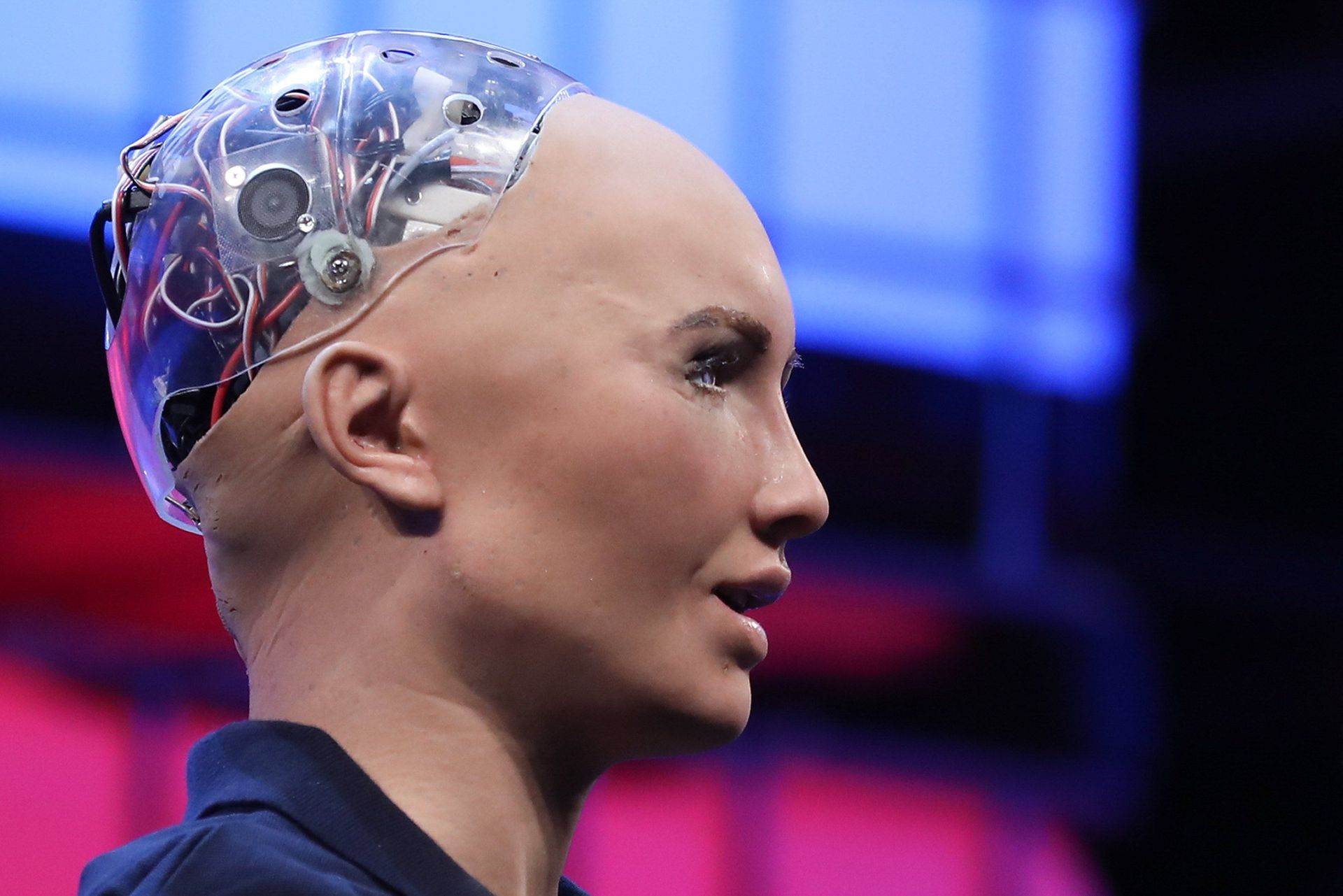

Wat we zien is dat huidige toepassingen van kunstmatige of artificiële intelligentie (AI), zoals zelfsturende auto’s of ‘intelligent’ communicerende chatbots, steeds vaker de mens naar de achtergrond duwen. Mensen blijven dikwijls wel eindverantwoordelijk maar het leeuwendeel van het ‘werk’ zal door AI-gebaseerde software worden gedaan.

Maar sterke (lees: echte) kunstmatige intelligentie vraagt meer dan het herkennen van patronen in grote hoeveelheden ruizige data. Wat ons mensen bijzonder maakt is de mogelijkheid tot denken in concepten, in taal: beter bekend als ons ‘talig vermogen’. Alles wat je verzint, denkt en voelt, gebeurt immers aan de hand van taal. En onder taal verstaan we niet het Nederlands of Italiaans, maar een soort interne stem waarmee we in ons hoofd met onszelf communiceren.

Dit talig vermogen stelt ons in staat te overleggen en gedachten te verwoorden om zo tot diepere inzichten te komen. Om kunstmatige intelligentie op menselijk niveau te brengen, moeten computers eerst geleerd worden te ‘denken in taal’. Het bedrijf dat dit het eerst voor elkaar weet te krijgen, heeft goud in handen. Sterke AI zal voorlopig nog wel een droom blijven en voorlopig richt men zich op de zwakke AI, want ook daar valt nog een wereld te winnen. En dat geldt zowel voor de op patroonherkenning, als de op taalgerichte AI.

Voor de ontwikkeling van AI zijn zoals bekend grote hoeveelheden data nodig; data die vanwege GDPR volgend jaar niet meer of slechts met grote moeite beschikbaar zal zijn voor Europese techbedrijven. De waarschijnlijkheid dat zij op internationaal niveau mee kunnen blijven doen met concurrenten uit de VS en China wordt met de dag kleiner. Juist nu heeft onze IT-sector meer data nodig.

Internet of Things

Neem de leasebranche. Met de komst van Internet of Things staat een groeiend aantal applicaties en apparatuur met elkaar in verbinding via het internet. Dit genereert een enorme hoeveelheid data die tot nu toe voornamelijk negatief in het nieuws komt. Er is echter ook een vaak onderbelichte en positieve kant. Dezelfde data kunnen namelijk gebruikt worden om bedrijfsprocessen te stroomlijnen, kosten en tijd te besparen en zelfs het milieu te ontzien door een verlaging van energiekosten en uitstoot. De les die we hieruit kunnen leren is de volgende: data op individueel niveau die tot een persoon kan worden herleid kunnen gevaarlijk zijn, maar geanonimiseerde data op groepsniveau kunnen daarentegen veel voordelen opleveren.

Geanonimiseerde data op groepsniveau kunnen bedrijfsprocessen stroomlijnen en zelfs het milieu ontzien door verlaging van uitstoot

Het aan de hand van de thermostaatdata uitvogelen hoe laat iemand meestal zijn huis verlaat en weer terugkomt kan het inbrekersgilde op verkeerde ideeën brengen, maar een geaggregeerde en geanonimiseerde verzameling van deze data kan verkeersspecialisten helpen bij het opzetten van een optimale inrichting van wegen en openbaar vervoer. Gemeenten moeten juist dit soort gegevens als open data beschikbaar maken in de hoop dat bedrijven er ‘handige’ diensten mee ontwikkelen: diensten waarvan we nu nog niet weten dat we ze nodig hebben!

Een wet zoals de GDPR stelt terecht strenge eisen aan de beheerders van data die tot personen te herleiden zijn, maar door te besluiten dat dit soort data niet meer gebruikt mogen worden, wordt het kind met het badwater weggegooid. De Europese IT-sector heeft toegang tot dit soort data nodig, wil ze de aansluiting met de rest van de wereld niet missen. Een aanpassing van de regels is wellicht niet nodig, maar de Europese lidstaten zouden gezamenlijk moeten nadenken hoe de data toch op een veilige manier beschikbaar kan worden gesteld voor ontwikkeling in de techsector. Alleen dan hebben Nederlandse en Europese IT-bedrijven een kans in de zoektocht naar de heilige graal van de IT: de omgang met de talig mens.